Large Behavior Models(LBM)の概要

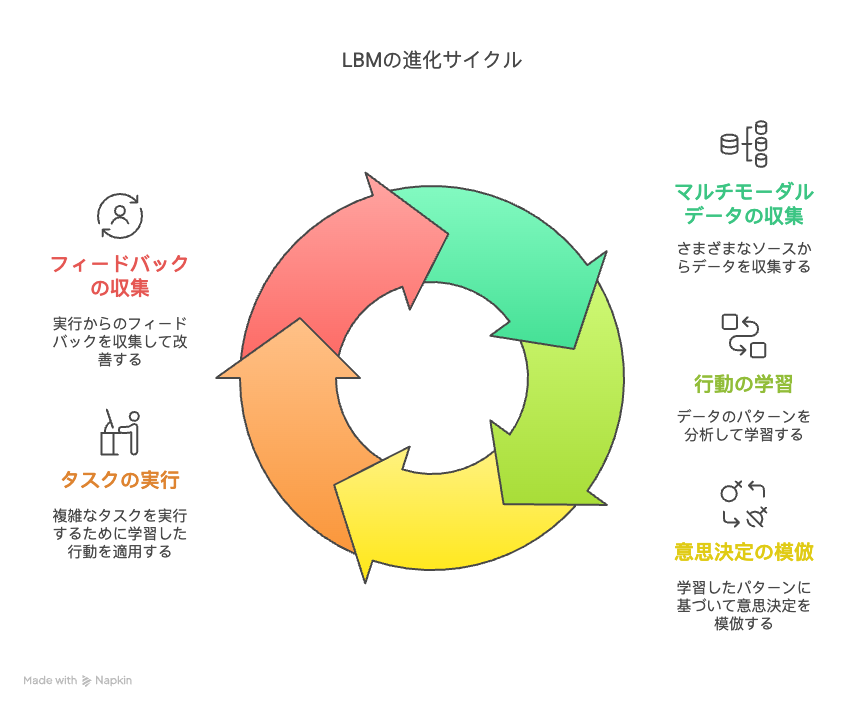

Large Behavior Models(LBM、大規模行動モデル)は、従来の大規模言語モデル(LLM)を発展させたAI技術であり、人間の行動や意思決定プロセスを模倣・学習することに重点を置いています。LBMは、言語だけでなく画像や音声などのマルチモーダルデータを活用し、複雑なタスクや実世界での行動を学習・実行できる点が特徴です[3]。

特徴

- 人間の行動観察や質問応答を通じて学習

- マルチモーダル(言語・画像・音声など)の情報処理

- 複雑なタスクの模倣・実行が可能

- 行動の正確な再現や誤学習の防止が研究課題[3]

- エージェントとしての自律性や協調性を重視

分類・上位概念・下位概念

| 概念 | 内容 |

|---|---|

| 上位概念 | 基盤モデル(Foundation Models)、第4世代AI[6] |

| LBM | 人間の行動・意思決定を模倣する大規模AIモデル |

| 下位概念 | 特化型行動モデル、マルチモーダル行動モデル、エージェント型LBMなど |

- 上位概念:基盤モデル(Foundation Models)、第4世代AI(知覚・運動系と知識・言語系の融合)[6]

- 下位概念:特定タスク向けLBM、マルチエージェントLBM、マルチモーダルLBMなど

メリット

- 複雑な実世界タスクへの適応力

- マルチモーダルな情報統合による高い表現力

- 人間の行動や意思決定の模倣による汎用性

- 自律的な学習・進化による新たなスキル獲得[2][3]

デメリット

- 誤学習やハルシネーション(虚偽生成)のリスク[1][3]

- 学習に大量のデータ・計算資源が必要[6]

- 分布外(未知状況)への弱さ[1][6]

- 倫理的・法的課題(安全性・信頼性・公平性・透明性)[3][6]

既存技術との比較

| 項目 | LLM(大規模言語モデル) | LBM(大規模行動モデル) |

|---|---|---|

| 主な対象 | 言語処理(テキスト生成など) | 行動・意思決定・マルチモーダル |

| 入力 | テキスト中心 | テキスト+画像+音声など複合入力 |

| 出力 | テキスト | 行動・操作・マルチモーダル出力 |

| 応用範囲 | 会話、要約、翻訳など | ロボティクス、エージェント、実世界タスク |

| 汎用性 | 高いが言語中心 | より高い(実世界適応を目指す) |

競合技術

- 大規模言語モデル(LLM:GPT-4, Llama, Claude等)[4][5]

- マルチモーダルAI(GPT-4V、Geminiなど)[5]

- 強化学習エージェント、ロボティクスAI

- 進化的アルゴリズムを用いた多目的最適化AI[2]

導入ポイント

- マルチモーダルなデータ収集・整備

- タスクに応じた事前学習・ファインチューニング

- 行動の正確性・安全性の検証

- 導入領域の倫理・法的要件の確認[3][6]

注意点

- ハルシネーションや誤学習への対策[1][3]

- データ偏りやバイアスの検証

- プライバシー・セキュリティ対応

- 社会的受容性や説明責任の確保[3][6]

今後の展望

- 知覚・運動系と知識・言語系AIのさらなる融合[6]

- マルチエージェント協調・競争による高度化[2]

- より現実世界に近い行動学習・適応能力の向上

- 倫理・法的枠組みの整備と社会実装の拡大[3][6]

関連キーワード

- LBM(Large Behavior Model)

- LLM(Large Language Model)

- マルチモーダルAI

- 基盤モデル(Foundation Model)

- エージェントAI

- 進化的アルゴリズム、Quality Diversity(QD)[2]

- ハルシネーション

- 説明可能AI(XAI)

- AI倫理・AI社会原則[6]

- マルチエージェントシステム

「LBMsは単なる言語処理を超え、人間の行動を学ぶAIです。人間が行動を観察し、質問を通じて学ぶように、LBMsは複雑なタスクをマスターします。」[3]

「第4世代AIは、知覚・運動系と知識・言語系のAI技術の融合による新しいAIの研究開発方向性である。」[6]

Citations: [1] https://www.docswell.com/s/sei_shinagawa/KL1QXL-beyond-accuracy-evaluating-the-behaivior-of-llm-survey [2] https://qiita.com/hiyoko1729/items/87f74bb7bc3b7b96b5be [3] https://workwonders.jp/media/archives/12407/ [4] https://www.jstage.jst.go.jp/article/jsceiii/4/3/4_474/pdf/-char/ja [5] https://www.jstage.jst.go.jp/article/jsceiii/5/3/5_220/pdf/-char/ja [6] https://www.mext.go.jp/content/240125_mxt_jyohoka01_000033728_08.pdf [7] https://keywordfinder.jp/blog/chatgpt/ [8] https://www.esri.cao.go.jp/jp/esri/archive/e_rnote/e_rnote090/e_rnote084.pdf [9] https://www.mext.go.jp/content/240125_mxt_jyohoka01_000033728_08.pdf [10] https://nagoya.repo.nii.ac.jp/record/1762/files/KJ00000726345.pdf [11] https://qiita.com/kzuzuo/items/237b9f5192464817aa40 [12] https://gakkai.sfc.keio.ac.jp/journal/.assets/SFCJ12-1-07.pdf [13] https://www.ipa.go.jp/archive/files/000033609.pdf [14] https://jasr.or.jp/wp/asr/asrpdf/asr25/asr25_020.pdf [15] https://www.jstage.jst.go.jp/article/jappstat/44/1-2/44_3/pdf/-char/ja [16] https://www.meti.go.jp/shingikai/mono_info_service/platform_economics/pdf/2023_002_03.pdf [17] https://doshisha.repo.nii.ac.jp/record/26386/files/017070030003.pdf [18] https://www.soumu.go.jp/johotsusintokei/linkdata/r06_01_houkoku.pdf [19] https://www.numo.or.jp/technology/technical_report/tr12_03pdf/TR-12-03.pdf [20] https://www.jst.go.jp/crds/pdf/2024/RR/CRDS-FY2024-RR-07.pdf [21] https://hirokatsukataoka.net/temp/presen/240621CVPR2024Report_finalized.pdf [22] https://www.ipa.go.jp/publish/wp-ai/qv6pgp0000000w5z-att/000088597.pdf [23] https://www.iwsec.org/scis/2025/program.html [24] https://www.jstage.jst.go.jp/article/sjpr/54/2/54_101/pdf/-char/ja [25] https://web.sfc.keio.ac.jp/~iba/tmp/IbaDoctor2003-abbr2009.pdf [26] https://ir.library.osaka-u.ac.jp/repo/ouka/all/1890/17056_Dissertation.pdf [27] https://www.jstage.jst.go.jp/article/jjsai/31/1/31_67/_pdf/-char/ja [28] https://note.com/rrrrrrrrrr_666/n/nb8c9010ce603

Answer from Perplexity: pplx.ai/share